Data pipeline باستخدام dbt و Snowflake و Airflow

تفاصيل العمل

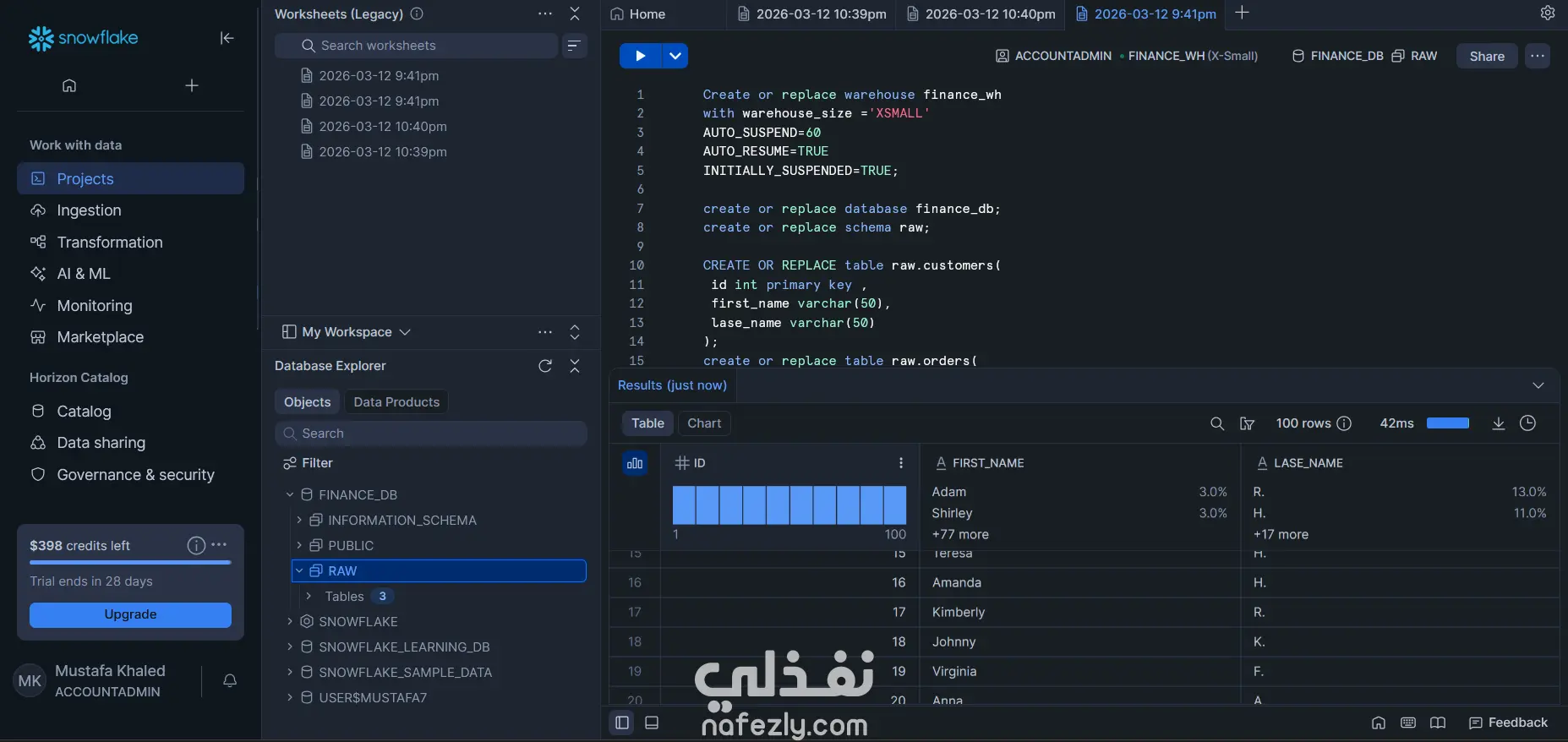

قمت ببناء Data Pipeline احترافي يربط بين البيانات الخام والتحليلات باستخدام أحدث أدوات الـ Data Engineering مثل dbt و Snowflake و Airflow. في هذا المشروع، قمت بتصميم وتنفيذ خط أنابيب بيانات (Data Pipeline) متكامل لمعالجة بيانات العملاء والطلبات والمدفوعات. اعتمدت على Snowflake كمخزن بيانات (Data Warehouse)، وdbt لتنفيذ عمليات التحويل (Transformations)، وApache Airflow لإدارة وتشغيل الـ Pipeline بشكل آلي. تم تنظيم البيانات عبر ثلاث جداول رئيسية: Customers Orders Payments وتم بناء علاقات واضحة بينها لتحليل سلوك العملاء وتتبع العمليات بشكل دقيق. المميزات الأساسية تصميم Data Warehouse باستخدام Snowflake بناء نماذج dbt لتنظيف وتحويل البيانات إنشاء DAGs باستخدام Airflow لأتمتة العمليات ربط البيانات بين Customers و Orders و Payments تحسين جودة البيانات (Data Quality) Pipeline قابل للتوسع وسهل التعديل التقنيات المستخدمة Snowflake dbt (Data Build Tool) Apache Airflow SQL Python

مهارات العمل